Google은 5일 발표한 Pixel 2를 공식 블로그에서 공개했다.

Pixel 2는 "Pixel Visual Core"로 불리는 화상 처리 프로세서가 탑재되었고 그로 인해 어두운 풍경에서 쾌청한 하늘까지 다양한 밝기의 장면으로 예쁜 사진을 찍을 수 있는 "HDR+" 테크놀로지를 실현하고 있다고 밝혔다.

구글은 HDR+를 효율적으로 처리함으로써 여러 사진을 차례로 촬영할 수 있도록 Pixel 2의 애플리케이션 프로세서를 사용하는 알고리즘을 진화시켰는데 동시에 하드웨어 개발에도 임하고 있어 서드 파티 사진 앱에서도 HDR+ 이용할 수 있도록 했다.

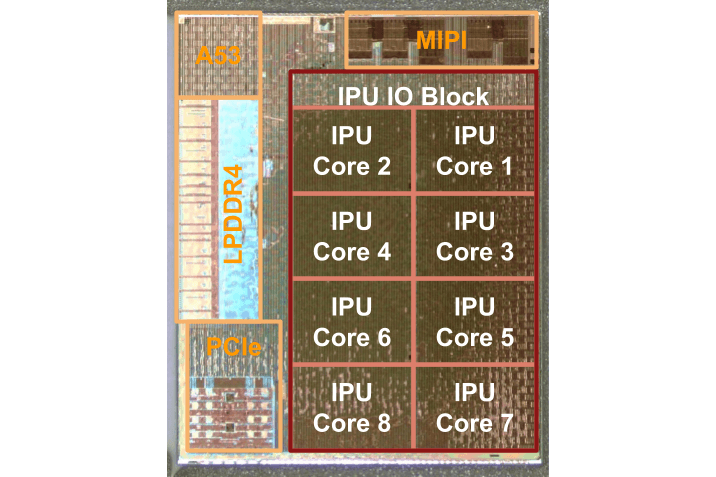

개발된 것은 Pixel Visual Core로 화상 처리나 머신러닝 작업에 저 레이턴시로 전력 효율이 높은 HDR+ 처리를 실현한다는 것이다. Pixel Visual Core는 컨슈머 제품용으로서는 Google의 첫 독자 설계의 코 프로세서로 Pixel 2 시리즈 전 제품에 탑재한다. 앞으로 몇달간 Pixel 2의 카메라를 사용해 다수의 앱으로 HDR+ 사진 촬영이 가능한 소프트웨어 업데이트가 전달될 예정이다.

Pixel Visual Core의 핵심은 Google이 설계한 화상 처리 유닛(IPU). 풀 프로그래머블 도메인 고유 프로세서로 저전력으로 최대의 성능을 발휘하도록 설계되고 있다. IPU는 각각 512개의 연산 논리 유닛(ALU)을 갖추며 Google이 독자적으로 설계한 커스텀 코어 8기로 모바일 단말기의 전력으로 3조회 이상의 처리를 실행할 수 있다.

HDR+ 처리에서 비교하면 Pixel Visual Core를 사용함으로써 애플리케이션 프로세서에서 실행하는 것보다 5배 고속, 10분의 1미만의 전력으로 실행할 수 있다. IPU의 효율성은 하드웨어와 소프트웨어의 긴밀한 연동으로 성립되어 있으며 Google의 소프트웨어는 하드웨어를 디테일하게 제어하고 있다.

소프트웨어 제어를 강화하면서 기존의 프로그래밍 언어를 사용해 IPU를 프로그래밍하는 것이 어렵기 때문에 구글은 이를 피하기 위해 화상 처리용 "Halide"와 머신러닝용 "TensorFlow" 2개의 고유 언어를 이용하여 개발자와 컴파일러의 부담을 경감하고 있다.

Pixel Visual Core는 향후 몇 주간 개발자용 프리뷰판 Android Oreo 8.1(MR1)의 개발자용 옵션으로서 이용이 가능하게 될 예정이며 이후 Android Camera API를 사용하는 모든 서드 파티 앱으로 Pixel 2의 HDR+ 테크놀로지가 사용된다.

현존 스마트폰 끝판왕 아이폰X의 ...

현존 스마트폰 끝판왕 아이폰X의 ...

소니, 엑스페리아 XZ1 컴팩트 국...

소니, 엑스페리아 XZ1 컴팩트 국...