미국 NVIDIA는 19일(미국 시간) PCI Express 카드 버전 GPU 액셀러레이터 "Tesla V100"을 발표했다.

이미 SXM2 버전과 함께 PCIe 버전이 존재하는 것이 발표됐으며 이번 발표에서 사양의 상세 내용이 밝혀졌다.

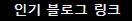

CUDA 코어과 딥 러닝 연산에 특화된 Tensor 코어의 수는 PCIe/SXM2 버전과 공통이지만 PCIe 버전은 소비 전력이 SXM2 버전의 300W에서 250W로 감소되고 연산 성능도 SXM2에서 약간 떨어졌다. 이는 Pascal 아키텍처를 채용한 "Tesla P100"과 같은 구성이다.

PCIe 버전 Tesla V100의 발매 시기를 NVIDIA는 Hewlett Packard Enterprise 등의 리셀러 파트너부터 올해 안에 제공된다고 밝혔다.

출처 - http://pc.watch.impress.co.jp/docs/news/1066480.html

| 모델 | Tesla V100 PCIe | Tesla V100 SXM2 | Tesla P100 PCIe | Tesla P100 SXM2 |

|---|---|---|---|---|

| 아키텍처 | Volta | Pascal | ||

| 프로세스 | 12 nm FFN | 16 nm FinFET+ | ||

| 트랜지스터 수 | 21.1억 | 15.3억 | ||

| CUDA 코어 수 | 5,120 | 3,584 | ||

| Tensor 코어 수 | 640 | - | ||

| 베이스 클럭 | ? | 1,126MHz | 1,328MHz | |

| 부스트 클럭 | ? | 1,455 MHz | 1,303MHz | 1,480 MHz |

| 배정밀도 성능(FP64) | 7 TFLOPs | 7.5 TFLOPs | 4.7 TFLOPs | 5.3TFLOPs |

| 단정밀도 성능(FP32) | 14 TFLOPs | 15 TFLOPs | 9.3 TFLOPs | 10.6 TFLOPs |

| 반정밀도 성능(FP16) | - | 18.7 TFLOPs | 21.2 TFLOPs | |

| Tensor 연산 성능 | 112 TFLOPs | 120 TFLOPs | - | |

| 메모리 | 4,096-bit HBM2 16GB | 3,072-bit HBM2 12GB 4,096-bit HBM2 16GB | 4,096-bit HBM2 16GB | |

| 메모리 대역 | 900 GB/s | 549 GB/s (12GB HBM2) 732 GB/s (16GB HBM2) | 732 GB/s | |

| 접속 인터페이스 | PCI Express 3.0 | NVLink | PCI Express 3.0 | NVLink |

| 폼 팩터 | PCIe FHFL | SXM2 | PCIe FHFL | SXM2 |

| 소비 전력 | 250W | 300W | 250W | 300W |

![[All Around AI 1편] AI의 시작과 발전 과정, 미래 전망 우리 삶을 혁신적으로 바꾸고 있는 인공지능(Artificial Intelligence, AI). AI를 알고, 이해하고 또 활용하고 싶은 이들을 위해 <AAA - All Around AI>에서 AI 기술에 대한 모든 것을 알려드립니다. 1화에서는 인공...](https://raptor-hw.net:42215/xe/files/thumbnails/198/205/241x165.crop.jpg)

![[All Around AI 1편] AI의 시작과 발전 과 [All Around AI 1편] AI의 시작과 발전 과 by 인공지능](https://raptor-hw.net:42215/xe/files/thumbnails/198/205/262x75.crop.jpg)